Das Problem…

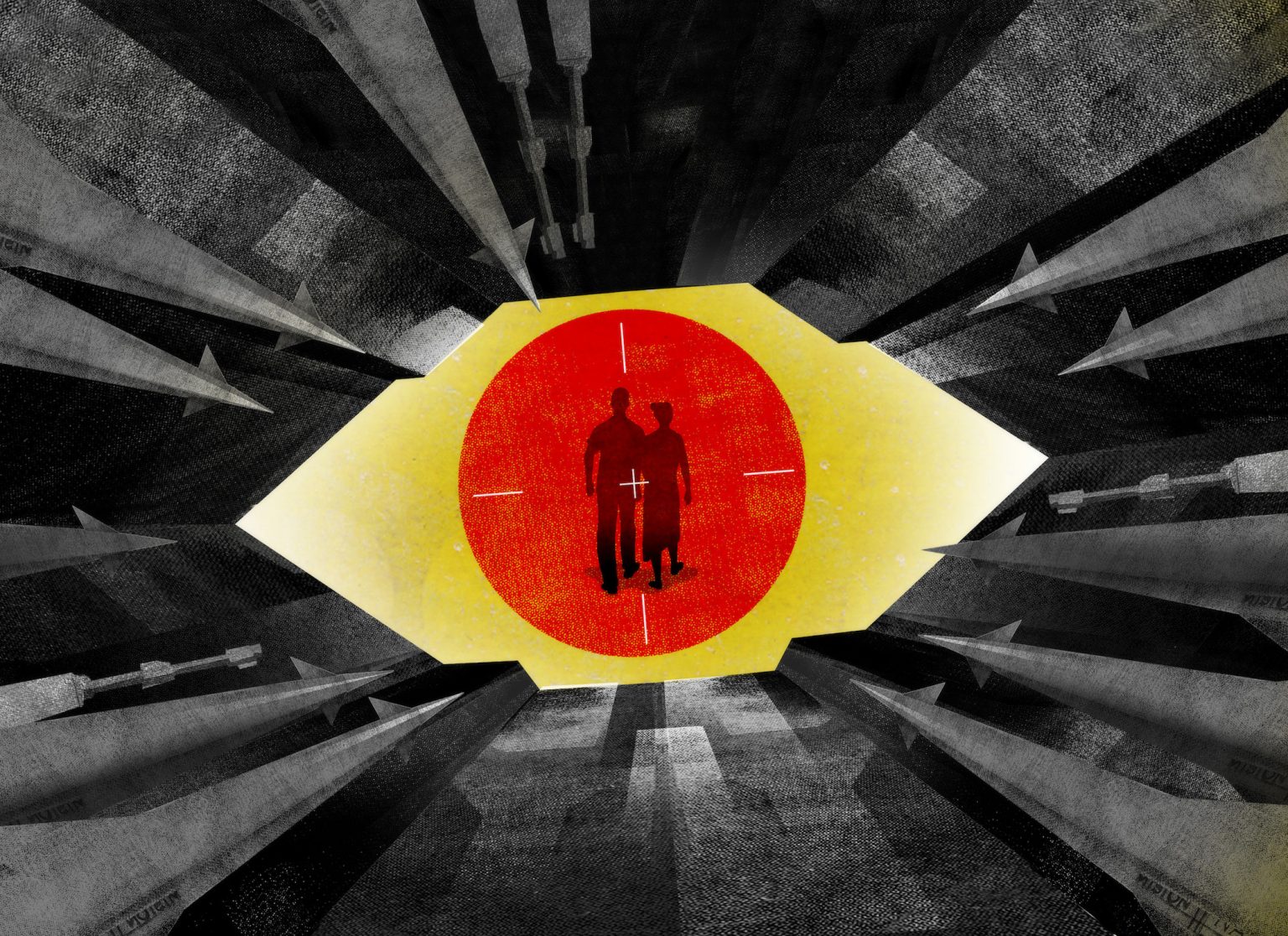

- Vollautonome Waffen würden ohne weiteren Eingriff des Menschen entscheiden, wer lebt und stirbt, was eine moralische Schwelle überschreitet. Als Maschinen würden ihnen die inhärent menschlichen Eigenschaften wie Mitgefühl fehlen, die notwendig sind, um komplexe ethische Entscheidungen zu treffen.

- Die USA, China, Israel, Südkorea, Russland und das Vereinigte Königreich entwickeln Waffensysteme mit erheblicher Autonomie bei den kritischen Funktionen der Auswahl und des Angriffs auf Ziele. Ohne Kontrolle könnte die Welt in ein destabilisierendes Wettrüsten von Robotern geraten.

- Das Ersetzen von Truppen durch Maschinen könnte die Entscheidung für einen Krieg erleichtern und die Konfliktlast noch weiter auf die Zivilbevölkerung verlagern. Vollautonome Waffen würden tragische Fehler mit unerwarteten Folgen begehen, die zu Spannungen führen könnten.

- Vollautonomen Waffen würde das menschliche Urteilsvermögen fehlen, um die Verhältnismäßigkeit eines Angriffs zu bewerten, Zivilisten von Kämpfern zu unterscheiden und andere Kernprinzipien der Kriegsgesetze einzuhalten. Die Geschichte zeigt, dass ihre Verwendung nicht auf bestimmte Umstände beschränkt wäre.

- Es ist unklar, wer, wenn überhaupt, für unrechtmäßige Handlungen verantwortlich gemacht werden könnte, die durch eine vollständig autonome Waffe verursacht wurden: der Programmierer, der Hersteller, der Kommandant und die Maschine selbst. Diese Lücke in der Verantwortlichkeit würde es schwierig machen, Gerechtigkeit zu gewährleisten, insbesondere für die Opfer.

- Vollständig autonome Waffen könnten auch in anderen Situationen außerhalb bewaffneter Konflikte eingesetzt werden, beispielsweise bei der Grenzkontrolle und bei der Polizeiarbeit. Sie könnten verwendet werden, um Protest- und Stützregime zu unterdrücken. Gewalt, die als nicht tödlich gedacht ist, kann immer noch viele Todesfälle verursachen.

Die Lösung…

- Die Entwicklung, Produktion und Nutzung von vollständig autonomen Waffen muss verboten werden!